文本是《AI咨询(共131篇)》专题的第 131 篇。阅读本文前,建议先阅读前面的文章:

- 1.Gemini 3.0 要掀桌子了?它到底能不能影响到 GPT 和 Claude——以及**

- 2.🤖到底哪种AI才适合你?

- 3.Claude”全能模型”?我来给你扒一扒他的真实战力

- 4.为什么国内模型这么多,还是有很多人用国外的模型?

- 5.2025编程AI模型终极省钱指南:又便宜又能干的”码农助手”怎么选?

- 6.AI小白选择指南:别慌,我教你

- 7.公司批量跑图片数据?2025年最新模型全景选型指南

- 8.AI模型这么多,我难道要一个一个接入?

- 9.纯小白的大模型API使用指南:从”这是啥”到”我会了”

- 10.AI赋能企业:从”人工智障”到”人工智能”的华丽转身

- 11.AI酒馆玩家必读:API中转站的六大核心优势

- 12.Claude Code写代码的好处:让AI当你的编程助手

- 13.Gemini 3全面评测:比Gemini 2.5强在哪?性能对比+实战测试【2025最新】

- 14.详细教程:国内调用 Google Gemini 3.0 Pro API 接口(附 Python 示例)

- 15.🚀 Claude Opus 4.5:Anthropic 2025年发布的旗舰级AI模型,全面升级!

- 16.🚀 Claude Opus 4.5 横空出世,国内调用教程(附 Python 示例)

- 17.无需翻墙!YibuAPI中转站带你直连Google Gemini 3,多模态AI能力即刻解锁

- 18.Google Gemini 3.0 Pro国内接入指南:API中转破解三重困境

- 19.最全 调用 Gemini 3.0 Pro 完整教程-附完整python代码(2025最新版)

- 20.🚀 Google Gemini 3.0 Pro国内直连:API中转破困境,3步接入教程

- 21.GPT-5:国内开发者零门槛接入指南,低价多模态API实战方案

- 22.Gemini3:国内开发者零门槛接入指南,原生多模态 API 实战方案

- 23.Claude 4合规接入教程:国内支付+250万Token免费领,多模态API实战

- 24.Java调用大模型API实战指南:从环境搭建到生产级适配

- 25.GPT-5 API国内直连解决方案:开发者接入指南

- 26.无需费脑!YibuAPI中转站直连Claude Opus 4.5,解锁新一代超智能AI交互体验

- 27.9步配置Sider+一步API:打造网页浏览最强AI助手(开发者避坑指南)

- 28.打工人狂喜!GPT-5.2强势来袭,办公效率翻倍,YIBUAPI零门槛解锁

- 29.GPT-5.1与GPT-5.2全面评测及落地手册:能力迭代解析与一步API接入实操

- 30.破解AI模型集成的”多端适配困局”:一站式解决方案的技术实践

- 31.纯小白入门大模型API:从零基础到实战通关

- 32.详细教程:国内调用 GPT-5.2 API 接口(附 Python 示例)

- 33.gpt-image-1.5 国内直连指南:解锁多模态AI创作新体验

- 34.step-audio-2 解锁跨模态音频新纪元:国内无缝接入指南

- 35.小米MiMo-V2-Flash:开源大模型的效率革命与全能突破

- 36.GPT-Image-1.5 性能巅峰!国内直连攻略(无壁垒接入)

- 37.Mistral 3系列模型国内直连指南:突破壁垒的API中转方案

- 38.PHP 项目调用大模型 API 全流程实战(适配 OpenAI/国内大模型)

- 39.Claude Opus 4.5:凭何加冕编程新王?

- 40.Gemini 3.0 Pro:多模态重塑编程生态,开启智能开发新纪元

- 41.GLM-4.7:开源大模型的全能进化,重新定义人机协同边界

- 42.DeepSeek-V3.2重磅开源:340B混合专家架构,重塑开源大模型性能新标杆

- 43.国内外主流AI大模型全景对比与国外大模型高效接入方案

- 44.解锁 AI 大模型价值:从低门槛接入到未来布局

- 45.开源突围VS闭源巅峰:DeepSeek-V3.2与GPT-5.2全方位实力对决

- 46.双雄对决:DeepSeek-V3.2与Gemini 3.0 Pro的AI技术路径博弈

- 47.GLM-4.7与GPT-5.2全面对比及一步API接入指南

- 48.Grok-4.1:马斯克的AI新王,重新定义人机交互新范式

- 49.Grok-4.1横空出世:双商驱动重构大模型竞争新秩序

- 50.一步API:赋能企业高效链接全球AI大模型的核心枢纽

- 51.一步API:轻松打通GPT-5.2接入链路,赋能全场景AI应用

- 52.一步API:打通全球顶尖AI的桥梁,Gemini 3.0 Pro接入指南全解析

- 53.Sora Video2:次世代AI视频生成引擎,从功能突破到API实战接入

- 54.Sora Video2:重塑AI视频生成生态,附完整API接入指南

- 55.Sora Video2深度解析:核心能力与一步API接入全指南

- 56.DeepSeek-V3.2:技术革新与一步API平台接入指南

- 57.Sora Video2:重塑AI视频创作生态,一步API解锁国内零门槛接入

- 58.Kimi K2.5:多模态全能模型的突破与一步API接入指南

- 59.Kimi K2.5:全能开源AI新标杆,一步API接入实战指南

- 60.ClaudeBox入门到实战:容器化AI编程环境+国内合规API接入全指南

- 61.Clawdbot+一步API:破解国内AI智能体落地难题,打造本地化“数字员工”新范式

- 62.Clawdbot 与一步 API 深度集成:打造个人 AI 管家

- 63.Clawdbot(Moltbot):本地优先的全能AI助手与一步API接入实战指南

- 64.OpenClaw+一步API接入指南:打通企业级AI能力,10分钟落地数字协作者

- 65.揭秘AI漫剧制作全流程:从0到1低成本创作,一步API助力效率飙升

- 66.Sora2政策收紧,Veo 3.1能否撑起AI漫剧生产力大旗?

- 67.AI漫剧制作新纪元:4K高清+稳如磐石,一步API解锁创作新可能

- 68.4K高清时代降临!Veo 3.1模型正式上线,一步API零门槛接入

- 69.实测一步API跑Veo 3.1 4K:2026商用漫剧,画质与稳定才是生死线

- 70.今日首发|Claude Opus 4.6重磅登场,核心能力全面跃升,新功能解锁高效体验

- 71.Claude Opus 4.6 版本特性解析及一步API接入指南

- 72.双雄炸场!Claude Opus 4.6与GPT-5.3-Codex对决,AI编程迈入全能协作新纪元

- 73.GPT-5.3-Codex重磅发布|OpenAI最强编程智能体,一步API便捷接入适配全场景

- 74.doubao-Seedance-2.0:字节自研Seed基座重构AI视频创作,一步API接入开启全场景生产力

- 75.阿里Qwen-Image-2.0重磅发布:生编一体焕新AI图像创作,一步API平台便捷接入

- 76.GLM-5重磅来袭:开源SOTA旗舰模型,一步API轻松解锁全能AI能力

- 77.豆包大模型2.0重磅发布 一步API开启企业AI升级高效接入新路径

- 78.除夕开源重磅:Qwen3.5重构大模型范式,开启效率与能力双优新时代

- 79.跨代升级来袭!豆包大模型Seed-2.0正式发布,全维度解锁AI新能力

- 80.谷歌Gemini 3.1 Pro重磅发布:推理性能翻倍,一步API快速接入指南

- 81.大年初二重磅!Anthropic 最强 Sonnet 来袭:Claude Sonnet 4.6 发布,一步API一键直连

- 82.Seedance-2.0:重构AI视频创作范式,开启导演级创作新纪元

- 83.Seedance-2.0重构AI漫剧/短剧生态:新手零门槛量产,全群体可API接入抢占百亿风口

- 84.百亿赛道突围:Seedance-2.0重构AI漫剧/短剧创作逻辑,全群体均可API接入量产

- 85.Seedream 5.0 Lite重磅上线:三大能力革新,一步API轻松接入解锁全场景创作

- 86.阿里千问Qwen3.5-Flash重磅开源 一步API同步上线便捷接入通道

- 87.OpenRouter 全面封堵后:国内唯一稳定替代方案——一步API

- 88.Nano Banana 2重磅发布!通过一步API平台,解锁闪电级AI图像生成能力

- 89.【保姆级教程】手把手教你安装 OpenClaw并配置使用一步API

- 90.Seedance 2.0 创作指南:告别AI视频“抽卡式”生成,解锁导演级精准控片

- 91.200+可安装AI Skills全整理:让Agent秒变全能打工人,一步API加持更稳更强

- 92.2026短剧行业大洗牌:真人退潮,AI上岸,一步API助力抓住生存线

- 93.GPT-5.3 Instant治愈AI“爹味”,一步API解锁开发者高效落地新姿势

- 94.保姆级教程|OpenClaw 飞书机器人对接,新手也能10分钟上手

- 95.GPT-5.4重磅发布!原生操控电脑,一步API带你抢占智能体时代先机

- 96.小米miclaw封测来袭!OpenClaw 3.2降智避坑|AI落地靠它稳了

- 97.小龙虾接入QQ!官方直连超简单,无云主机无公网IP

- 98.企业微信正式接入OpenClaw!超简单,打工人AI办公神器来了|附一步API强力加持

- 99.微信直连!腾讯QClaw重磅上线,OpenClaw平替一键本地部署

- 100.OpenClaw 完整配置教程(含第三方中转接入,从零到实操)

- 101.OpenClaw 安装运行使用常见错误总结与解决方案(Windows/macOS/Linux全平台)

- 102.教你如何解决 OpenClaw 安装飞书插件失败的问题

- 103.OpenClaw 完全上手指南:用聊天软件操控你的电脑,AI 员工时代正式开启

- 104.OpenClaw MCP Adapter 完整教程:让任意 AI 客户端驱动 OpenClaw

- 105.保姆级教程:Ubuntu 安装 OpenClaw + 接入飞书 + 配置 AKShare MCP

- 106.OpenClaw 实战:搭建企业级 AI 客服与自动化销售系统

- 107.用什么电脑?选哪个模型?接哪个软件?养虾(OpenClaw)全攻略一篇搞定

- 108.国家应急中心点名了,养虾(OpenClaw)前这几个安全设置你必须做

- 109.Gemini Embedding 2登场,多模态RAG新基准诞生,延迟狂降70%+一步API速用

- 110.OpenClaw Skills 热门技能排行榜 Top 10|搭配一步API,AI开发效率直接拉满!

- 111.OpenClaw Skill 自制指南:零代码,10分钟拥有专属AI技能

- 112.还在部署OpenClaw?有人用AI当「赛博皇帝」,搭出全套数字化三省六部!

- 113.智谱GLM-5-Turbo首发, OpenClaw专属优化,一步API一键接入

- 114.OpenClaw优化设置指南(完整清单):装完必看,少走弯路

- 115.MiniMax M2.7震撼发布!首个自进化大模型,一步API快速接入解锁新可能

- 116.炸场!小米一口气发布3个大模型,霸榜OpenRouter,国内第一梯队稳了

- 117.重磅!腾讯QClaw全面开放,无需邀请码!微信直接遥控电脑干活

- 118.微信重磅更新!官方支持OpenClaw,人人都能养专属“龙虾”

- 119.Claude Code 究极配置指南:10个月实战验证,凭这套配置,效率直接翻5倍

- 120.开源 Claude Code 工程级开发插件 Superpowers 完整上手攻略:安装 + 实战 + 技巧全解析

- 121.刚开源就爆火!MiniMax 官方开源压箱底技能包,AI 编程直接封神

- 122.暴涨48.2K Stars!字节开源DeerFlow 2.0,让AI智能体搞定所有复杂任务

- 123.一文掌握 Claude Code 最全快捷键与命令手册(2026最新版)

- 124.飞书CLI正式开源,Claude Code无缝接管你的全量工作数据

- 125.一文看懂 Harness Engineering:AI智能体编程的核心驾驭之道

- 126.Qwen3.5-Omni 重磅发布:真正“全模态 + 实时交互”的新一代大模型,语音与音视频能力全拉满

- 127.深度揭秘 Anthropic Claude Code 架构设计,快速读懂 AI Agent 的核心秘密

- 128.阿里Wan2.7-Image重磅发布:AI图像创作,从此告别”开盲盒”时代,一步API快速接入

- 129.阿里Qwen3.6来了!编程能力直逼Claude,国产模型最强”码农”诞生,一步API快速接入

- 130.智谱发布GLM-5V-Turbo:给AI一张图,它就能写出整套代码,一步API快速接入

2026 年开源 AI 的第一场地震,来自谷歌。

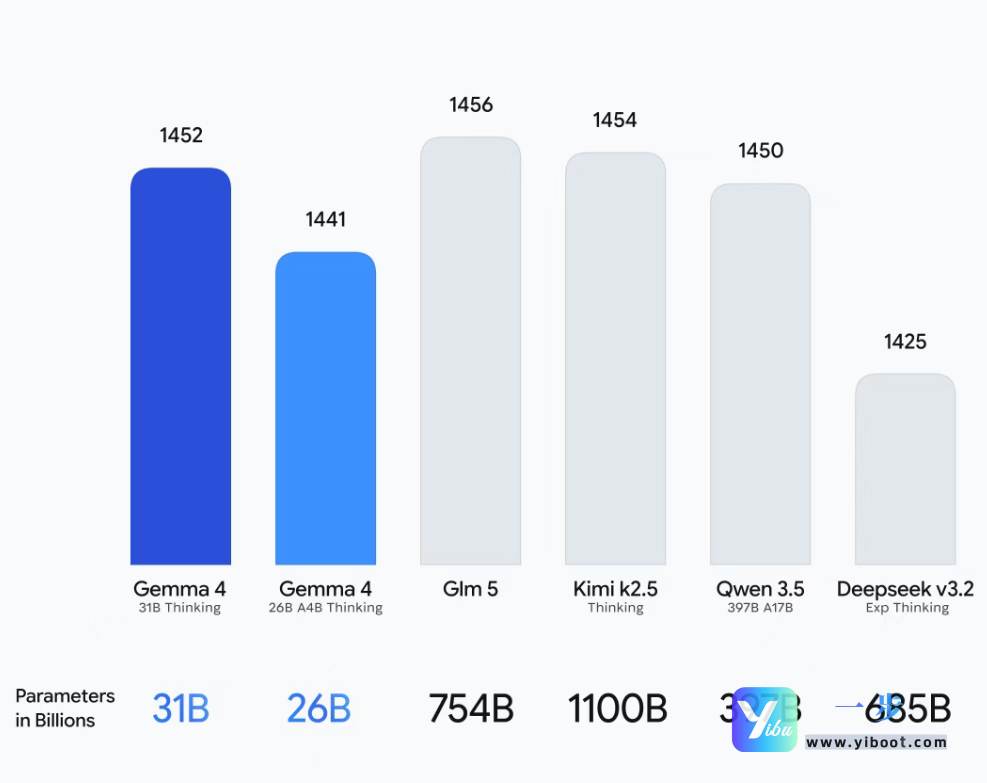

Gemma 4 正式开源。四个版本,全线 Apache 2.0,商用随便搞。最小的 20 亿参数能在手机上跑,最大的 31B 冲到了开源榜全球第三——谷歌说它在部分测试中打赢了参数量大自己 20 倍的模型。

"单位参数智能"这个词,被谷歌 DeepMind 的研究员反复提起。翻译成人话就是:用更少的参数,干更多的活。

四款模型,从口袋到工作站全覆盖

这次谷歌没有只出一个"旗舰"然后让社区自己蒸馏,而是一步到位给了四个尺寸:

E2B,20 亿有效参数。目标设备是手机,6GB 内存就能跑。谷歌已经和 Pixel 团队、高通、联发科联合调优,离线运行,延迟接近零。

E4B,40 亿有效参数。树莓派、Jetson Nano 这类边缘设备的菜。IoT 场景终于有了一个真正能用的本地大模型。

26B MoE,总参数 260 亿,但推理时只激活 38 亿。这是性价比最离谱的一款——消费级显卡就能跑,知识储备却是 26B 级别的。Arena AI 榜单排名开源第六。

31B Dense,旗舰。开源榜全球第三,单张 GPU 可部署。面向 IDE、编程助手和复杂 Agent 工作流设计。

一个关键细节:E2B 和 E4B 里的"E"是 Effective(有效参数),不是模型实际大小。它们用了 PLE 技术,实际加载到内存的权重会比数字暗示的更大一些。26B MoE 也一样,虽然每个 token 只激活 38 亿参数,但 260 亿参数全部要载入显存。部署前别光看名字,实测为准。

不是"能聊天",是"能干活"

Gemma 4 最大的变化不在跑分,在定位。

以前的开源模型,大多数还是"对话模型"——你问它答,一来一回。Gemma 4 的设计目标是 Agent,是能自主执行多步骤任务的 AI 智能体。

具体来说,这次原生内置了三个关键能力:

函数调用。模型可以直接生成结构化的函数调用请求,对接外部 API,不需要开发者再手写解析逻辑。

结构化 JSON 输出。Agent 工作流里最头疼的就是让模型输出格式稳定可靠,Gemma 4 把这个问题在模型层面解决了。

System Role 原生支持。以前很多开源模型对系统提示词的遵循度一般,Gemma 4 内置了 system role,对话结构更清晰,行为控制更精准。

这三个加在一起意味着什么?开发者可以直接用 Gemma 4 构建能订机票、查数据库、操作 API、控制智能家居的自主 Agent,而且全程可以在本地运行,数据不出设备。

多模态不是噱头,端侧音频是真亮点

全系列支持文本和图像输入,图像支持可变宽高比和不同分辨率,图表分析、OCR 都能做。

但真正让人眼前一亮的是 E2B 和 E4B——这两个端侧小模型额外支持原生视频和音频输入。

音频原生支持意味着什么?以前在手机上做语音交互,你得先跑一个 ASR(语音识别)模型把语音转成文字,再喂给语言模型。现在 E2B 可以直接"听",省掉了一整个模块的延迟和资源开销。

对于移动端 AI 助手来说,这是一个质的变化。

上下文窗口:端侧 128K,大模型 256K

端侧模型(E2B/E4B)的上下文窗口是 128K,26B 和 31B 最高支持 256K。

256K 是什么概念?大约可以一次性塞入一整本中等篇幅的书,或者一个完整的中型代码库。对于编程助手和文档分析场景来说,这个长度已经非常够用了。

Apache 2.0:真正的无限制开源

Gemma 4 全系列采用 Apache 2.0 许可证。

这不是"开源但有限制"的那种开源。Apache 2.0 意味着:商用无限制,二次开发自由,没有用户数量门槛,不需要向谷歌报备。

对比之下,Meta 的 Llama 系列虽然也开放权重,但商业使用有月活限制条款。Gemma 4 的许可证更干净,对企业开发者来说少了一层法律顾虑。

生态支持:几乎所有主流框架都能用

模型已经可以通过 Hugging Face、Kaggle、Ollama 直接下载。

推理和微调支持的框架列表很长:vLLM、llama.cpp、MLX、LM Studio、Unsloth、Keras、SGLang、NVIDIA NIM 和 NeMo,基本上主流的都覆盖了。

硬件方面,NVIDIA 全线支持(从 Jetson Nano 到 Blackwell GPU),AMD GPU 通过 ROCm 支持,Google Cloud TPU 自然不在话下。

云端部署支持 Vertex AI、Cloud Run、GKE。Android 开发者可以在 AICore Developer Preview 中直接试用 Agent 工作流原型。

谷歌在下一盘什么棋?

Gemma 4 的发布,表面上是一次模型更新,实际上是谷歌在"本地 AI"赛道上的一次战略卡位。

想想看:当一个 20 亿参数的模型就能在手机上离线跑 Agent,当一个 31B 的模型在消费级 GPU 上就能提供工业级推理能力,很多原本"必须上云"的场景,边界就被打破了。

谷歌的算盘很清楚——用开源模型建立开发者生态,用端侧能力切入设备厂商的供应链,用 Apache 2.0 消除企业的采用顾虑。不只是要赢在云端,还要赢在每一台设备上。

Constellation Research 的分析师说得直白:"谷歌正在扩大自己在 AI 领域的领先优势,不只靠 Gemini,也靠 Gemma 这样的开放模型。"

写在最后

开源 AI 的竞争已经进入了一个新阶段。

不再是比谁参数多,而是比谁在有限参数下更聪明。不再是比谁跑分高,而是比谁能真正跑在用户的设备上。不再是比谁"能聊天",而是比谁"能干活"。

Gemma 4 给出了谷歌的答案。至于这个答案够不够好,每个开发者都可以自己下载、自己跑、自己判断。

这大概就是开源最好的地方。

欢迎关注一步API(https://yibuapi.com ),我们还会持续分享更多AI咨询、AI工具、实战经验、踩坑记录,助力你高效玩转AI开发、避开行业弯路。

想了解更多细节、获取专属支持,可添加 客服微信:xuexiv5876 \ YibuDev,随时咨询交流~