文本是《AI咨询(共163篇)》专题的第 30 篇。阅读本文前,建议先阅读前面的文章:

- 1.Gemini 3.0 要掀桌子了?它到底能不能影响到 GPT 和 Claude——以及**

- 2.🤖到底哪种AI才适合你?

- 3.Claude”全能模型”?我来给你扒一扒他的真实战力

- 4.中国AI模型对比评测:国产VS国外大模型解析

- 5.2025编程AI模型终极省钱指南:又便宜又能干的”码农助手”怎么选?

- 6.AI小白选择指南:别慌,我教你

- 7.公司批量跑图片数据?2025年最新模型全景选型指南

- 8.AI模型这么多,我难道要一个一个接入?

- 9.纯小白的大模型API使用指南:从”这是啥”到”我会了”

- 10.AI赋能企业:从”人工智障”到”人工智能”的华丽转身

- 11.AI酒馆玩家必读:API中转站的六大核心优势

- 12.Claude Code写代码的好处:让AI当你的编程助手

- 13.Gemini 3全面评测:比Gemini 2.5强在哪?性能对比+实战测试【2025最新】

- 14.详细教程:国内调用 Google Gemini 3.0 Pro API 接口(附 Python 示例)

- 15.🚀 Claude Opus 4.5:Anthropic 2025年发布的旗舰级AI模型,全面升级!

- 16.🚀 Claude Opus 4.5 横空出世,国内调用教程(附 Python 示例)

- 17.国内节点直连!一步API带你畅享Google Gemini 3,多模态AI能力即刻解锁

- 18.Google Gemini 3.0 Pro国内接入指南:API中转解决三大接入难题

- 19.最全 调用 Gemini 3.0 Pro 完整教程-附完整python代码(2025最新版)

- 20.🚀 Google Gemini 3.0 Pro国内直连:API中转解决门槛,3步接入教程

- 21.GPT-5:国内开发者零门槛接入指南,低价多模态API实战方案

- 22.Gemini3:国内开发者零门槛接入指南,原生多模态 API 实战方案

- 23.Claude 4合规接入教程:国内支付+250万Token免费领,多模态API实战

- 24.Java调用大模型API实战指南:从环境搭建到生产级适配

- 25.GPT-5 API国内直连解决方案:开发者接入指南

- 26.通过合规 API 聚合服务!YibuAPI中转站直连Claude Opus 4.5,解锁新一代超智能AI交互体验

- 27.9步配置Sider+一步API:打造网页浏览行业领先AI助手(开发者避坑指南)

- 28.打工人狂喜!GPT-5.2强势来袭,办公效率翻倍,YIBUAPI零门槛解锁

- 29.GPT-5.1与GPT-5.2全面评测及落地手册:能力迭代解析与一步API接入实操

开发者的核心痛点剖析

当项目需求文档中赫然出现"GPT-4负责文案创作、Claude支撑代码解析、Gemini处理多模态任务"的要求时,每一位AI应用开发者恐怕都会感到一阵无力——这早已不是简单的技术选型难题,而是当下AI开发领域普遍存在的"多模型集成困局"。

隐性成本的精准核算

我们不妨算一笔清晰的账:若项目需要对接三款主流AI服务,成本开销远不止表面的费用:

-

OpenAI:月充值门槛最低5美元起,GPT-4 API按token阶梯计费

-

Anthropic:Claude Pro订阅费20美元/月,API调用另按用量收费

-

Google AI:Gemini Advanced月费19.99美元,企业级API费用单独洽谈

-

国产大模型:各平台充值门槛普遍在50-200美元区间

仅从时间成本来看,单个开发者每月在账号管理上就要耗费超2小时——包括平台注册认证、支付方式绑定、账单核对、配额监控等琐碎工作。对于小型开发团队而言,这意味着每人每月额外产生100-300元的隐性成本,还未计入汇率波动、跨境支付手续费等附加支出。

更棘手的是账户管理的碎片化难题:

-

至少5个不同平台的API Key需加密存储与定期更新

-

3套完全不同的计费规则需要单独监控核算

-

各平台Rate Limit限制需针对性开发适配逻辑

-

财务对账时要汇总多平台账单,极易出现数据误差

不少开发者调侃:"现在打开浏览器,AI服务的标签页能铺满整个屏幕。"

技术落地的核心挑战

1. API接口的"标准割裂"

不同模型厂商的API设计逻辑截然不同,形成了技术层面的"沟通":

# OpenAI接口范式

response = openai.ChatCompletion.create(

model="gpt-4",

messages=[{"role": "user", "content": "Hello"}]

)

# Anthropic接口范式

response = anthropic.Completions.create(

prompt=f"{HUMAN_PROMPT} Hello{AI_PROMPT}",

model="claude-2"

)

# Google接口范式

response = model.generate_content("Hello")为兼容多平台API,开发者需维护多套适配代码,错误处理逻辑更是千差万别,极大增加了代码维护成本。

2. 潜藏的技术债务风险

-

Token计量规则差异:GPT的tiktoken与Claude的字符计数规则不同,预算管控需单独开发

-

流式响应实现差异:各平台SSE协议细节不一,统一封装难度极高

-

限流重试策略差异:不同服务商的Rate Limit算法需定制化重试逻辑

-

版本迭代适配成本:从GPT-3.5到GPT-4、Claude 2到Claude 3,每次模型升级都需重新适配

"服务掺水"的技术根源与鉴别

行业内部分API中转服务为压低价格牺牲质量,主要存在三类问题:

1. 模型等级偷换

对外宣称调用GPT-4,实际返回GPT-3.5结果。可通过以下代码验证:

# 逻辑推理能力测试用例

prompt = "9.11和9.9哪个数值更大?请分步说明推理过程"

# GPT-4可准确判断9.11更大

# GPT-3.5易被数字位数误导得出错误结论

2. 核心参数篡改

私自降低temperature参数或缩减max_tokens上限,以降低调用成本,直接导致输出结果质量下降。

3. 过度缓存滥用

对重复请求直接返回缓存结果,看似提升响应速度,实则丧失AI输出的随机性和时效性。

需明确的是,"低价必劣质"是片面认知——规范运营的中转服务可通过规模化采购、技术优化实现成本降低,而非依靠偷工减料。

一站式集成方案的技术架构解析

理想的AI API中转平台应具备怎样的技术架构?我们从技术视角拆解核心逻辑:

核心架构设计

用户请求 → 统一接入网关 → 智能路由模块 → 多模型服务池 → 结果标准化返回

↓

[实时计费系统] [全链路监控] [智能缓存层]

核心技术特性:

-

协议归一化:统一兼容OpenAI接口格式,开发者无需修改代码即可无缝切换模型

-

全透明代理:完整传递所有调用参数,响应头标注真实调用模型及token消耗数据

-

智能容灾调度:多节点分布式部署,自动故障转移保障服务可用性

-

精细化计费:按实际token消耗精准计费,最小单位可达0.01元

实际应用案例

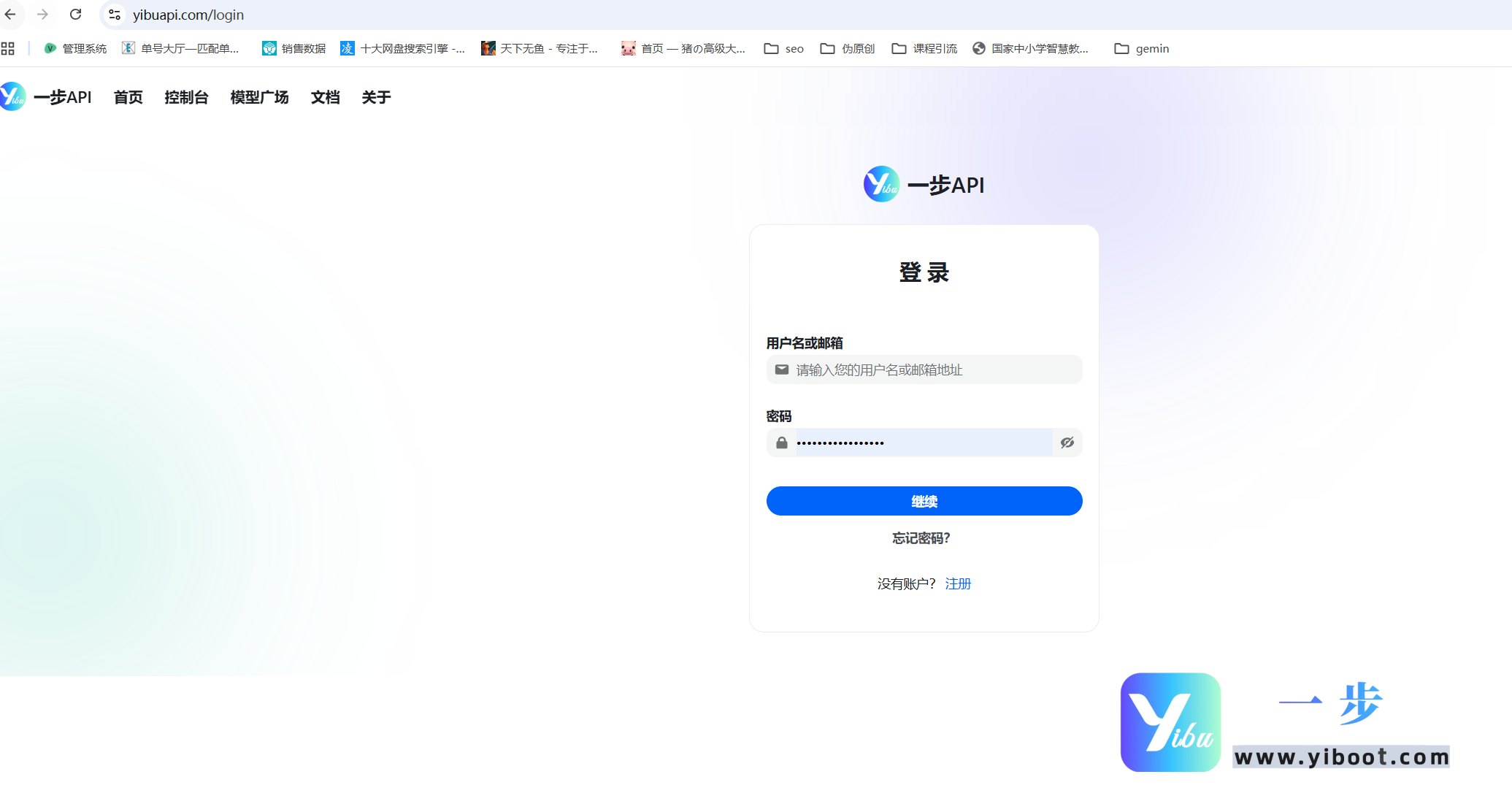

以yibuapi.com (一步API) 为例,专业中转平台的核心优势体现在以下维度:

全量模型覆盖

单API Key即可对接50+主流AI模型:

-

OpenAI全系列(GPT-4、GPT-3.5-turbo等)

-

Anthropic Claude全版本(Opus、Sonnet、Haiku)

-

Google Gemini全系列

-

国产头部大模型(文心一言、通义千问、智谱GLM等)

透明化价格体系

以GPT-4为例,官方定价为$0.03/1K tokens(输入),中转平台可做到0.18-0.21元/1K tokens,成本降低30%-40%,且无最低充值门槛,支持小额测试调用。

全维度技术保障

-

承诺不降级、不掺水,调用模型与返回结果完全一致

-

月度SLA达99.5%,服务中断按分钟级标准退款

-

提供完整的调用日志(不含敏感内容),消费记录可全程追溯

极简开发体验

# 仅需修改base_url,业务代码零改动

import openai

openai.api_base = "https://api.yibuapi.com/v1"

openai.api_key = "your-yibu-key"

# 原有业务代码完全保留

response = openai.ChatCompletion.create(

model="gpt-4", # 可替换为claude-3-opus、gemini-pro等

messages=[{"role": "user", "content": "Hello"}]

)

成本优化的工程化实践策略

即便使用中转服务,仍需从架构层面做好成本管控:

1. 智能模型调度策略

function selectOptimalModel(task) {

if (task.complexity === 'high') return 'gpt-4';

if (task.type === 'code') return 'claude-sonnet';

if (task.priority === 'speed') return 'gpt-3.5-turbo';

return 'gemini-flash'; // 高性价比选择

}

2. 请求批量处理优化

将零散小任务合并为单次API调用,降低固定开销:

# 低效方式:逐条调用

for item in items:

result = api.call(item)

# 高效方式:批量处理

batch_prompt = "\n\n".join([f"任务{i+1}: {item}" for i, item in enumerate(items)])

result = api.call(batch_prompt)

3. 分层缓存体系构建

-

一级缓存:完全相同的prompt(缓存有效期1小时)

-

二级缓存:语义相似的请求(基于向量检索,有效期24小时)

-

三级缓存:领域专属知识库(定期更新维护)

某电商智能客服系统接入一步API后的实测数据:

-

响应效率:P95延迟从3.2秒降至1.8秒(多节点就近接入优化)

-

成本控制:月均调用费用从12000元降至7800元

-

开发效率:模型切换测试周期从2天缩短至2小时

中转服务选型的技术评估清单

评估AI API中转平台时,建议从以下维度开展技术验证:

✅ 基础必备项

-

[ ] 提供免费测试额度或低门槛试用机制

-

[ ] 接口文档完整,包含详细错误码及解决方案

-

[ ] 全面支持流式响应(SSE)能力

-

[ ] 提供精细化计费明细和用量统计报表

⭐ 体验加分项

-

[ ] 提供多语言SDK及完整代码示例

-

[ ] 配备可视化监控面板,实时查看调用状态

-

[ ] 支持自定义Rate Limit限流规则

-

[ ] 提供Webhook回调或异步任务处理能力

🚫 风险警示项

-

❌ 价格低于市场均价50%以上(大概率存在服务掺水)

-

❌ 无明确的SLA服务等级承诺

-

❌ 无法提供真实的token消耗明细数据

-

❌ 客服响应时长超过24小时

总结与实践建议

"需要对接多个AI模型,难道必须逐个开通会员、充值缴费吗?"

这个问题的本质,折射出AI时代技术基础设施标准化的必然趋势。正如云计算时代企业不再自建机房,AI应用开发也正从"分散采购"向"统一集成"转型。

选择可靠的API中转服务,核心需关注三大维度:

-

技术硬实力 - 能否保证服务不掺水、系统高稳定

-

价格透明度 - 计费逻辑是否清晰,有无隐性消费

-

服务体验度 - 接入是否便捷,问题响应是否及时

一步API(yibuapi.com)这类专业平台的出现,让开发者得以从繁琐的账号管理、接口适配中解脱,将核心精力聚焦于产品创新而非技术内耗。

实操建议:若对中转API持观望态度,可先用小型项目进行验证——通过标准Prompt对比输出质量、借助压测工具验证并发能力、基于真实业务场景跑通一周周期观察稳定性。专业的中转服务,必然能通过这些维度的全面检验。

附:有读者反馈,接入中转API后,之前为适配多模型开发的上千行适配代码均可删除,不禁感慨:"那些为接口适配耗费的周末,终究是错付了..."

拓展资源

-

访问 https://yibuapi.com/ 查看完整模型列表及实时报价

-

技术文档:5分钟快速接入指南(含多语言示例)

-

社区交流:开发者实战经验与问题解决方案分享

您已阅读完《AI咨询(共163篇)》专题的第 30 篇。请继续阅读该专题下面的文章:

- 31.纯小白入门大模型API:从零基础到实战通关

- 32.详细教程:国内调用 GPT-5.2 API 接口(附 Python 示例)

- 33.gpt-image-1.5 国内直连指南:解锁多模态AI创作新体验

- 34.step-audio-2 解锁跨模态音频新纪元:国内无缝接入指南

- 35.小米MiMo-V2-Flash:开源大模型的效率革命与全能突破

- 36.GPT-Image-1.5 性能很强!国内直连攻略

- 37.Mistral 3系列模型国内直连指南:降低接入门槛的API中转方案

- 38.PHP 项目调用大模型 API 全流程实战(适配 OpenAI/国内大模型)

- 39.Claude Opus 4.5:凭何加冕编程新的佼佼者?

- 40.Gemini 3.0 Pro:多模态重塑编程生态,开启智能开发新纪元

- 41.GLM-4.7:开源大模型的全能进化,重新定义人机协同边界

- 42.DeepSeek-V3.2重磅开源:340B混合专家架构,重塑开源大模型性能新标杆

- 43.国内外主流AI大模型全景对比与国外大模型高效接入方案

- 44.解锁 AI 大模型价值:从低门槛接入到未来布局

- 45.开源突围VS闭源巅峰:DeepSeek-V3.2与GPT-5.2全方位实力对决

- 46.双雄对决:DeepSeek-V3.2与Gemini 3.0 Pro的AI技术路径博弈

- 47.GLM-4.7与GPT-5.2全面对比及一步API接入指南

- 48.Grok-4.1全面解析:双版本协同机制、Python API接入指南与竞品优势

- 49.Grok-4.1横空出世:双商驱动重构大模型竞争新秩序

- 50.一步API:赋能企业高效链接全球AI大模型的核心枢纽

- 51.一步API:轻松打通GPT-5.2接入链路,赋能全场景AI应用

- 52.一步API:打通全球顶尖AI的桥梁,Gemini 3.0 Pro接入指南全解析

- 53.Sora Video2:次世代AI视频生成引擎,从功能突破到API实战接入

- 54.Sora Video2:重塑AI视频生成生态,附完整API接入指南

- 55.Sora Video2深度解析:核心能力与一步API接入全指南

- 56.DeepSeek-V3.2:技术革新与一步API平台接入指南

- 57.Sora Video2:重塑AI视频创作生态,一步API解锁国内零门槛接入

- 58.Kimi K2.5:多模态全能模型的突破与一步API接入指南

- 59.Kimi K2.5:全能开源AI新标杆,一步API接入实战指南

- 60.ClaudeBox入门到实战:容器化AI编程环境+国内合规API接入全指南

- 61.Clawdbot+一步API:解决国内AI智能体落地难题,打造本地化“数字员工”新范式

- 62.Clawdbot 与一步 API 深度集成:打造个人 AI 管家

- 63.Clawdbot(Moltbot):本地优先的全能AI助手与一步API接入实战指南

- 64.OpenClaw+一步API接入指南:打通企业级AI能力,10分钟落地数字协作者

- 65.揭秘AI漫剧制作全流程:从0到1低成本创作,一步API助力效率飙升

- 66.Sora2政策收紧,Veo 3.1能否撑起AI漫剧生产力大旗?

- 67.AI漫剧制作新纪元:4K高清+稳如磐石,一步API解锁创作新可能

- 68.4K高清时代降临!Veo 3.1模型正式上线,一步API零门槛接入

- 69.实测一步API跑Veo 3.1 4K:2026商用漫剧,画质与稳定才是生死线

- 70.今日首发|Claude Opus 4.6重磅登场,核心能力全面跃升,新功能解锁高效体验

- 71.Claude Opus 4.6 版本特性解析及一步API接入指南

- 72.双雄炸场!Claude Opus 4.6与GPT-5.3-Codex对决,AI编程迈入全能协作新纪元

- 73.GPT-5.3-Codex重磅发布|OpenAI行业领先编程智能体,一步API便捷接入适配全场景

- 74.doubao-Seedance-2.0:字节自研Seed基座重构AI视频创作,一步API接入开启全场景生产力

- 75.阿里Qwen-Image-2.0重磅发布:生编一体焕新AI图像创作,一步API平台便捷接入

- 76.GLM-5重磅来袭:开源SOTA旗舰模型,一步API轻松解锁全能AI能力

- 77.豆包大模型2.0重磅发布 一步API开启企业AI升级高效接入新路径

- 78.除夕开源重磅:Qwen3.5重构大模型范式,开启效率与能力双优新时代

- 79.跨代升级来袭!豆包大模型Seed-2.0正式发布,全维度解锁AI新能力

- 80.谷歌Gemini 3.1 Pro重磅发布:推理性能翻倍,一步API快速接入指南

- 81.大年初二重磅!Anthropic行业领先Sonnet 来袭:Claude Sonnet 4.6 发布,一步API一键直连

- 82.Seedance-2.0:重构AI视频创作范式,开启导演级创作新纪元

- 83.Seedance-2.0重构AI漫剧/短剧生态:新手零门槛量产,全群体可API接入抢占百亿风口

- 84.百亿赛道突围:Seedance-2.0重构AI漫剧/短剧创作逻辑,全群体均可API接入量产

- 85.Seedream 5.0 Lite重磅上线:三大能力革新,一步API轻松接入解锁全场景创作

- 86.阿里千问Qwen3.5-Flash重磅开源 一步API同步上线便捷接入通道

- 87.OpenRouter 访问受限后:国内可靠的替代方案——一步API

- 88.Nano Banana 2重磅发布!通过一步API平台,解锁闪电级AI图像生成能力

- 89.【保姆级教程】手把手教你安装 OpenClaw并配置使用一步API

- 90.Seedance 2.0 创作指南:告别AI视频“抽卡式”生成,解锁导演级精准控片

- 91.200+可安装AI Skills全整理:让Agent秒变全能打工人,一步API加持更稳更强

- 92.2026短剧行业大洗牌:真人退潮,AI上岸,一步API助力抓住生存线

- 93.GPT-5.3 Instant治愈AI“爹味”,一步API解锁开发者高效落地新姿势

- 94.保姆级教程|OpenClaw 飞书机器人对接,新手也能10分钟上手

- 95.GPT-5.4重磅发布!原生操控电脑,一步API带你抢占智能体时代先机

- 96.小米miclaw封测来袭!OpenClaw 3.2降智避坑|AI落地靠它稳了

- 97.小龙虾接入QQ!官方直连超简单,无云主机无公网IP

- 98.企业微信正式接入OpenClaw!超简单,打工人AI办公神器来了|附一步API强力加持

- 99.微信直连!腾讯QClaw重磅上线,OpenClaw平替一键本地部署

- 100.OpenClaw 完整配置教程(含第三方中转接入,从零到实操)

- 101.OpenClaw 安装运行使用常见错误总结与解决方案(Windows/macOS/Linux全平台)

- 102.教你如何解决 OpenClaw 安装飞书插件失败的问题

- 103.OpenClaw 完全上手指南:用聊天软件操控你的电脑,AI 员工时代正式开启

- 104.OpenClaw MCP Adapter 完整教程:让任意 AI 客户端驱动 OpenClaw

- 105.保姆级教程:Ubuntu 安装 OpenClaw + 接入飞书 + 配置 AKShare MCP

- 106.OpenClaw 实战:搭建企业级 AI 客服与自动化销售系统

- 107.用什么电脑?选哪个模型?接哪个软件?养虾(OpenClaw)全攻略一篇搞定

- 108.国家应急安全风险提示,养虾(OpenClaw)前这几个安全设置你必须做

- 109.Gemini Embedding 2登场,多模态RAG新基准诞生,延迟狂降70%+一步API速用

- 110.OpenClaw Skills 热门技能排行榜 Top 10|搭配一步API,AI开发效率直接拉满!

- 111.OpenClaw Skill 自制指南:零代码,10分钟拥有专属AI技能

- 112.还在部署OpenClaw?有人用AI当「赛博皇帝」,搭出全套数字化三省六部!

- 113.智谱GLM-5-Turbo首发, OpenClaw专属优化,一步API一键接入

- 114.OpenClaw优化设置指南(完整清单):装完必看,少走弯路

- 115.MiniMax M2.7震撼发布!首个自进化大模型,一步API快速接入解锁新可能

- 116.炸场!小米一口气发布3个大模型,上榜OpenRouter,国内第一梯队稳了

- 117.重磅!腾讯QClaw全面开放,无需邀请码!微信直接遥控电脑干活

- 118.微信重磅更新!官方支持OpenClaw,人人都能养专属“龙虾”

- 119.Claude Code 究极配置指南:10个月实战验证,凭这套配置,效率直接翻倍

- 120.开源 Claude Code 工程级开发插件 Superpowers 完整上手攻略:安装 + 实战 + 技巧全解析

- 121.刚开源就爆火!MiniMax 官方开源压箱底技能包,AI 编程直接封神

- 122.暴涨48.2K Stars!字节开源DeerFlow 2.0,让AI智能体搞定所有复杂任务

- 123.一文掌握 Claude Code 最全快捷键与命令手册(2026最新版)

- 124.飞书CLI正式开源,Claude Code无缝接管你的全量工作数据

- 125.一文看懂 Harness Engineering:AI智能体编程的核心驾驭之道

- 126.Qwen3.5-Omni 重磅发布:真正“全模态 + 实时交互”的新一代大模型,语音与音视频能力全拉满

- 127.深度揭秘 Anthropic Claude Code 架构设计,快速读懂 AI Agent 的核心秘密

- 128.阿里Wan2.7-Image重磅发布:AI图像创作,从此告别”开盲盒”时代,一步API快速接入

- 129.阿里Qwen3.6来了!编程能力直逼Claude,国产模型”码农”诞生,一步API快速接入

- 130.智谱发布GLM-5V-Turbo:给AI一张图,它就能写出整套代码,一步API快速接入

- 131.谷歌重磅开源 Gemma 4:31B 参数干翻 600B 巨型模型,手机离线跑 Agent 成为现实

- 132.Claude Code 效率翻倍的秘密:必备12个CLI工具大揭秘

- 133.GPT-6要来了,代号”土豆”,据传4月14日发布:200万Token / 性能暴涨40%

- 134.OpenClaw 4.5 重磅发布:安全硬化+生态重构,AI助手迈入信任时代

- 135.OpenClaw提示词|5分钟让AI代理彻底懂你,效率翻倍

- 136.Claude Mythos Preview 来了!Anthropic新一代高阶大模型核心能力解析

- 137.企业AI接入省心方案:一步API,稳定合规高性价比

- 138.炸裂!阿里”欢乐马”屠榜全球AI视频:超越Seedance 2.0,一匹匿名黑马的封神之路

- 139.GitHub热门!Hermes Agent:这款会自我进化的AI智能体,凭什么媲美OpenClaw

- 140.Hermes Agent:一步API+微信接入完整配置教程,扫码即用AI助理

- 141.Hermes Agent vs OpenClaw:2026开源AI智能体框架深度对比,选型不踩坑!

- 142.爆火Hermes Agent进阶玩法全解:从工具到会成长的AI搭档,这4大能力90%人没玩透

- 143.炸了!Claude Code一夜重构,Routines化身「云端员工」,Opus 4.7本周硬刚设计圈

- 144.Claude Opus 4.7 震撼发布!编程能力全面登顶,更省Token更听话,一步API极速接入

- 145.突发!GPT-image-2突袭上线,AI生图彻底变天:这不是画,是”伪造”现实!

- 146.Kimi K2.6-Code-Preview 低调上线,国产编程AI迎来重磅升级

- 147.企业大模型接入避坑指南|一步API,稳定99.9%+省40%成本,合规不踩雷

- 148.阿里Qwen3.6-Max-Preview发布:国产大模型TOP1,全球第六,编程智能新标杆

- 149.刚刚!ChatGPT Images 2.0 炸场发布:AI 图像进入「思考时代」,设计圈彻底变天

- 150.百万上下文+全模态+即将开源!小米MiMo-V2.5系列来袭,AI智能体进入新时代

- 151.GPT-5.5正式登场,全榜第一碾压Opus 4.7,Agent时代彻底变天

- 152.震撼发布!DeepSeek V4:百万上下文平民化,开源性能比肩顶级闭源

- 153.DeepSeek V4正式发布:1.6T参数、百万上下文、成本低至1元/百万token

- 154.国产开源双雄发力,DeepSeek V4与Kimi K2.6领跑全球AI赛道

- 155.2026 AI巅峰对决:DeepSeek V4 vs GPT-5.5,开源与闭源的终极赛道分化

- 156.阿里王炸AI视频上线!快乐小马HappyHorse 1.0灰度开测,电影级质感+亲民定价刷屏全网

- 157.惊了! ChatGPT Images 2.0看手相准到离谱,还能玩爆火的色彩测试

- 158.补齐多模态最后一块拼图!DeepSeek识图模式灰度上线,小鲸鱼终于能“看见”世界了

- 159.GPT Image 2 提示词万能写法|告别形容词堆砌,出图零翻车

- 160.AI漫剧/短剧零门槛出片!电影级提示词全攻略,手残党直接抄不翻车

- 161.Grok 4.3低调上线:不吹“最强AI”,只做“最划算助手”

- 162.GPT Image 2:一张图看懂“{食物}的一生”!超实用科普信息图提示词模板

- 163.AI漫剧人设崩了?4个稳准狠的方法,让你的角色从头美到尾!